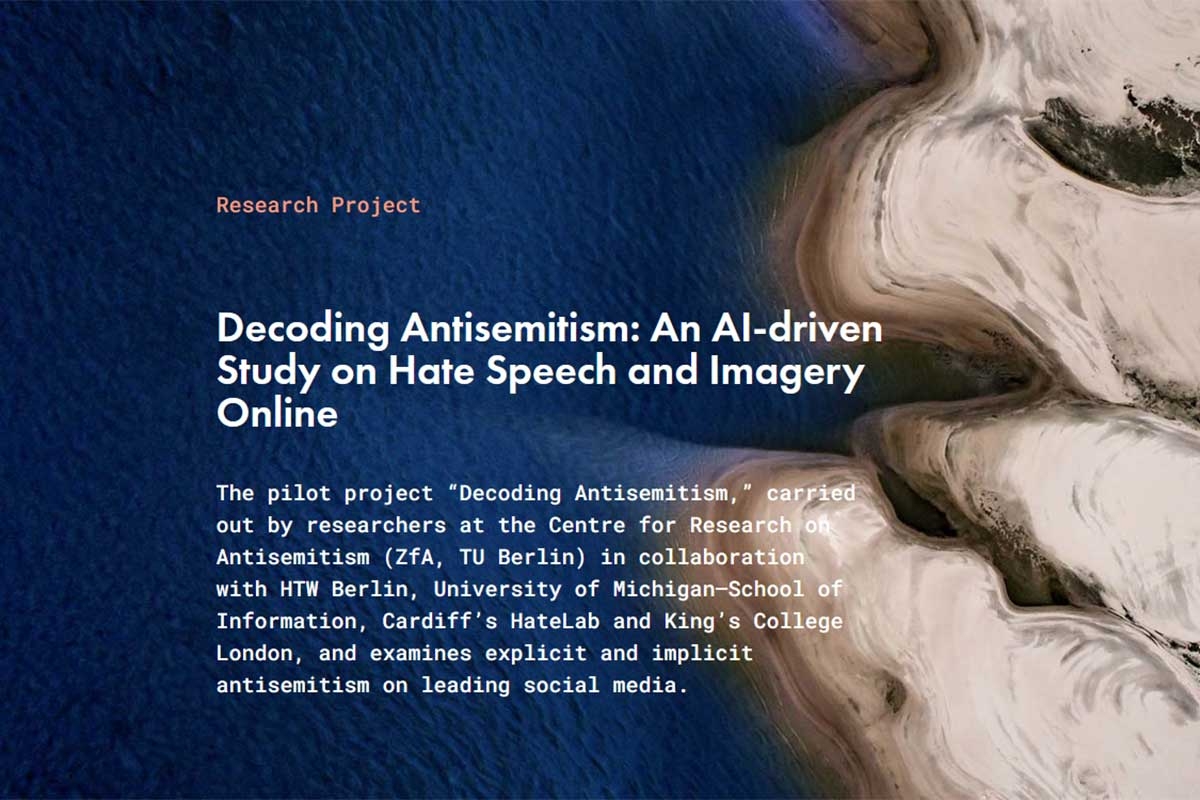

»Künstliche Intelligenz kann codierten Antisemitismus erfassen«

Was soll mit dem Projekt erreicht werden?

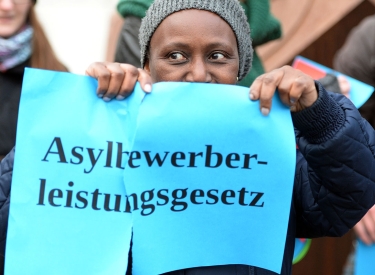

Das Ziel ist es, Antisemitismus online in seiner gesamten konzeptuellen und sprachlich-strukturellen Breite zu erfassen, gerade im Kontext politisch moderater, das heißt konservativer bis linksliberaler Medien in Großbritannien, Frankreich und Deutschland. Im Vordergrund standen anfangs die Kommentarbereiche von entsprechenden News-Websites. Seit 2021 haben wir allerdings immer stärker Plattformen wie Facebook, Instagram, Youtube, Twitter/X und Tiktok untersucht.

Warum?

Wir wollen Social Media Studies und das Verständnis von Antisemitismus als Hassideologie stärker miteinander verknüpfen. Dafür wenden wir eine interdisziplinäre Herangehensweise an und kombinieren Linguistik, Diskurs- und Bildungsforschung, Antisemitism Studies sowie Sozialwissenschaften mit der Forschung zu Künstlicher Intelligenz. Die qualitativ annotierten Dateien aus mehr als 130 000 User:innen-Kommentaren dienen als Trainingsmaterial für Large Language Models, die fortan nach unserem Vorbild Einstufungen vornehmen. Neben Diskursforschung und KI-Training geht es aber auch darum, einen intensiven Dialog zwischen Forschung und Pädagogik, Politik, Medien, Sicherheit und Justiz herzustellen.

»Antisemitische Gewalt führte weniger zu Trivialisierung oder Leugnung, sondern zu offener verbaler Gewalt und deren Rechtfertigung, zu Hohn und Schadenfreude oder Frauenfeindschaft.«

Was ist das wichtigste Ergebnis bisher?

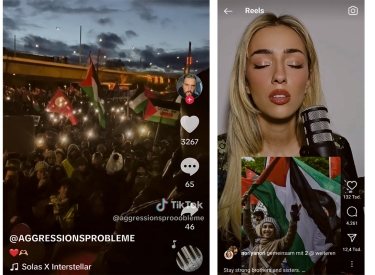

Dass Künstliche Intelligenz dazu in der Lage ist, auch codierten Antisemitismus zu erfassen. Außerdem haben wir bei den qualitativen Analysen festgestellt, dass von den drei untersuchten Ländern Großbritannien stets den größten Anteil von Antisemitismus aufwies. Dieser wurde zudem recht deutlich kommuniziert. Deutschland war oftmals Schlusslicht, was verschiedene Gründe hat und natürlich nicht darüber hinwegtäuscht, dass Antisemitismus dennoch ein großes Problem darstellt. Eine weitere Auffälligkeit ist der Wendepunkt 7. Oktober, bei dem nicht nur Antisemitismus massiv zunahm, sondern auch immer stärker durch Selbstpositionierungen getragen wurde.

Was haben Sie konkret sei dem 7. Oktober wahrgenommen?

Antisemitismus hat sich direkt am 7. Oktober und den Tagen danach verdoppelt, teils verdreifacht. Es veränderte sich aber nicht nur die Quantität, sondern auch die Qualität des Antisemitismus. User:innen brachten weniger Stereotype und Analogien hervor, sondern äußerten geradeheraus Affirmation und Gewaltverherrlichungen mit Blick auf die Hamas-Verbrechen. Antisemitische Gewalt führte weniger zu Trivialisierung oder Leugnung, sondern zu offener verbaler Gewalt und deren Rechtfertigung, zu Hohn und Schadenfreude oder Frauenfeindschaft. Die Unterstützung und Rechtfertigung des Terrorangriffs machen im deutschsprachigen Facebook 19 Prozent der antisemitischen Kommentare aus, im französischen Facebook und auf britischen Youtube-Kommentaren sind es sogar über 50 Prozent.

Können Large Language Models überhaupt mit der stetigen Veränderung antisemitischer Online-Sprache Schritt halten?

Bilder, die in bestimmten Kontexten mit einer antisemitischen Bedeutung aufgeladen werden, können recht leicht eingeordnet werden. Schwerer zu erkennen sind aber Phrasen oder Sprechakte sowie Anspielungen auf historische Verbrechen oder antisemitische Stereotype, denn hier braucht man kontextuelles und Weltwissen.

Einfach zu toxisch

Einfach zu toxisch